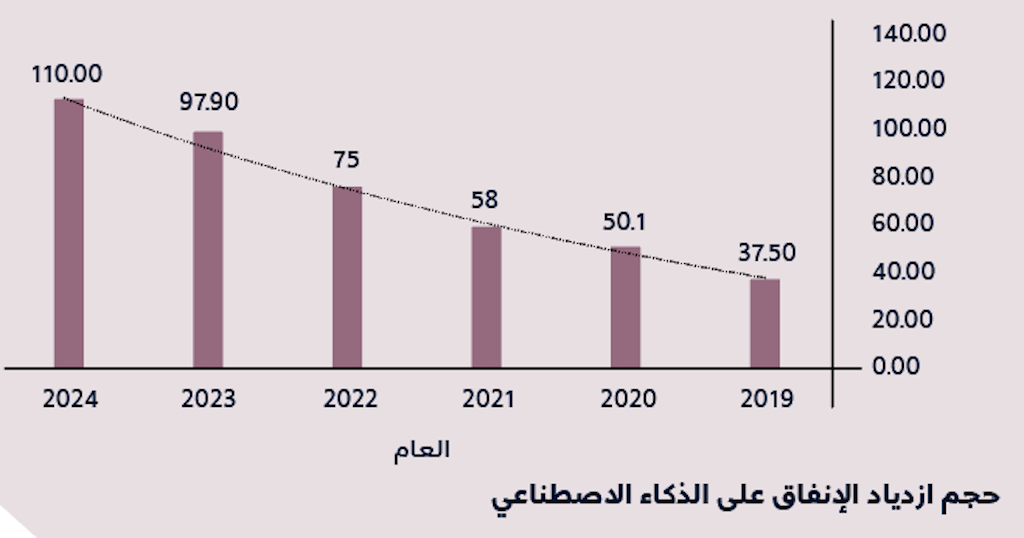

يُشير الذكاء الاصطناعي إلى تقنيات تُحاكي ذكاء الدماغ البشري، وأي آلة تقوم بوظائف عقل الإنسان. وظهر المصطلح في عام 1956م، ثم تبعه مصطلح “تعلم آلة” بعده بثلاث سنوات. ولأهميته، فمن المتوقع أن يتضاعف الإنفاق العالمي على تقنيات الذكاء الاصطناعي، حيث سينمو من 50.1 بليون دولار في 2020م إلى أكثر من 110 بلايين دولار في 2024م. ويرى تقرير “اليونيسكو”، أن سباق العالم المتقدِّم نحو “التطوير الأكثر ذكاءً” مدفوعٌ بالتقنيات الرقمية، وعلى رأسها: الذكاء الاصطناعي و“الروبوتات” والبيانات الضخمة و“الكوبوتات”، والأتمتة، وإنترنت الأشياء، و“البلوكتشين”. واندماج التقنيات الرقمية مع تقنيات النانو والحيوية وعلوم المعرفة، يُشكّل حجر الأساس للثورة الصناعية الرابعة. ولاعتماد ازدهار الاقتصاد الأمريكي على الاستثمار في زعامة أمريكا التقنية، أنشأت إدارة الرئيس “بايدن” “فريق عمل الموارد الوطنية لأبحاث الذكاء الاصطناعي” بناءً على توجيهات الكونجرس في “قانون المبادرة الوطنية للذكاء الاصطناعي 2020 “.

عناوين جانبية:من المتوقَّع أن يتضاعف الإنفاق العالمي على تقنيات الذكاء الاصطناعي، إلى أكثر من 110 بلايين دولار بحلول عام 2024م.

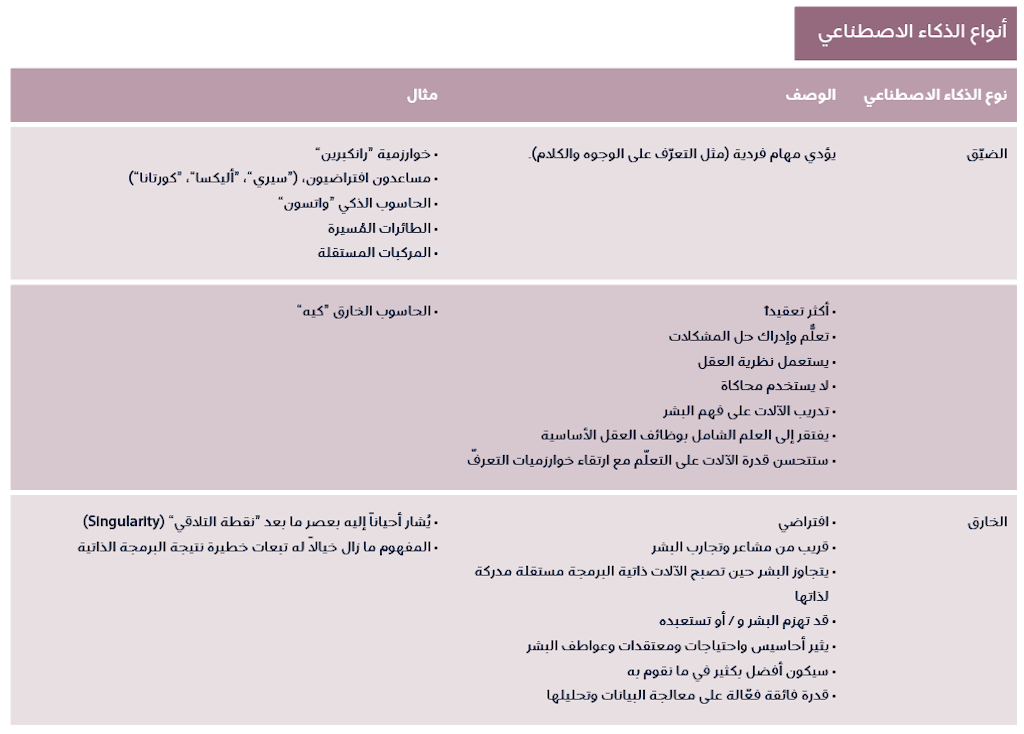

ويتميز الذكاء الاصطناعي الخارق بملامح استثنائية عدّة:

• ظهور مفاجئ

• آخر اختراع يحتاجه البشر

• سهولة نسخه أكثر رقيّاً ذاتياً

• مبادرات مستقلة

• خالٍ من القِيَم الإنسانية

• لا يمتلك روحاً ولا عقلاً، لكن ذكاءه الاصطناعي سيفوق ذكاء البشر

• تسريع التقدُّم التقني في مجالات أخرى

وتستطيع نُظم الذكاء الاصطناعي التنبؤ واتخاذ القرارات في حالات واقعية وافتراضية من خلال تقنيات فرعية، مثل:

• تعلم آلة: ويشمل التعلّم العميق والتعلّم المعزِّز؛

• استدلال آلة: ويشمل التخطيط والجدولة أو البرمجة وتمثيل المعرفة والبحث والتحسين؛

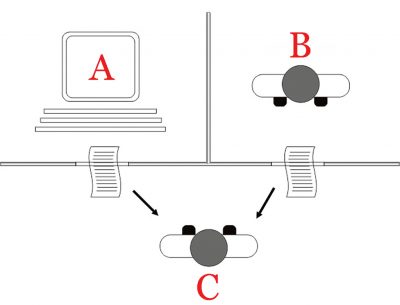

• نُظم “سيبرية- فيزيائية”: تضم إنترنت أشياء، والنُظم الروبوتية الاجتماعية، والتفاعل بين الإنسان والحاسوب، والسيطرة والإدراك، ومعالجة البيانات الضخمة من أجهزة الاستشعار، وتفعيل المشغلات actuator.

إيجابيات

للذكاء الاصطناعي إسهامات إيجابية، فقد أدخل تحسّناً في أكثر من قطاع:

تهديدات

مع الإيجابيات يحمل الذكاء الاصطناعي في طياته تهديدات ومخاطر أخلاقية. فقد وضع ارتقاء قدرات الذكاء الاصطناعي الكثير في ريْبٍ من المخاطر المصاحبة له، فتصاعد الاهتمام بتهديداته الأخلاقية حديثاً. ويمكن أن تشمل التهديدات: الإقصاء، والمطورون، و”الأنسنة”، والتزييف. لذلك وضعت اليونيسكو “وثيقة المشروع الأولي للتوصيات الخاصة بأخلاقيات الذكاء الاصطناعي” لحماية ولتعزيز حقوق الإنسان وكرامته واحترام سيادة القانون في العالم الرقمي.

فمثلاً، الأنظمة الذكية التي تحمي البرمجيات ضد “المخترقين”، هي نفسها تُستخدم لاختراق البرمجيات. والإبهام في تصميم استخدام الذكاء الاصطناعي لحماية الأمن السيبراني أو سوء استخدامه يحمل في طياته مخاطر أمنية. ونفس الطائرة المسيّرة لتوصيل الطرود بفوائدها تستطيع قذف المتفجرات وتصبح سلاح دمار شامل رشيق المناورات صعب الرصد. ويُستثمر ذكاء “صوفيا” الاصطناعي في التنمية المستدامة ولكن في المقابل ينجم عنه بطالة لأتمتة الوظائف. ويمكن أن يُعظّم ذكاء اصطناعي العائد لصالح المرضى، ويقدر أيضاً تخفيضه لصالح المؤسسات. وأنت تشاهد التلفاز الذكي وتتمتع بمميزاته الذكية، وفي المقابل التلفاز يشاهدك أيضاً فتذهب خصوصيتك. و”إشكالية من المسيطر؟” هاجس، حيث سيكون هناك فرصة واحدة لدينا لعلاج سيطرة الذكاء الاصطناعي إذا وقع المحظور.

تستطيع نُظم الذكاء الاصطناعي التنبؤ واتخاذ القرارات في حالات واقعية وافتراضية من خلال تقنيات فرعية، مثل: تعلُّم آلة، استدلال آلة، نُظم “سيبرية- فيزيائية”.

واستطاع “تعلّم آلة” تصنيع هياكل وأجهزة وأنظمة وجسيمات متدنية الأحجام في نطاق الجزيء والنانو. وتسبب هذا “التصنيع الجزيئي” Molecular Manufacturing في تطوير منتجات وخدمات نانوية فعّالة تشمل: أدوية، ومواد كيماوية للزراعة المستدامة، وحاسبات بيولوجية فائقة السرعة، وأسلحة متطورة، ومروحيات مستقلة على المريخ، والقضاء على الشيخوخة، ونمو الاقتصاد، و”روبوتات نانوية” ذاتية التكرار تسبح في الجسم بتحكم الدماغ لعلاج الحالات صعبة التشخيص. لكن، يثير ربط نشاط الدماغ بالحاسب مخاوف أخلاقية واجتماعية، حيث تبيَّن أن بعض المرضى الذين خضعوا لتحفيز الدماغ العميق لعلاج مرض “باركنسون” اعتراهم جنس مفرط، أو انفعالات منفلتة. ولأن “الروبوتات النانوية” ستحصل على الطاقة والمواد اللازمة من البيئة مباشرة من دون رقيب فتُستهلك الموارد بمعدلات مرتفعة، ويختل التوازن العسكري، ويشق التصدي للإرهاب.

وأثارت حمّى الذكاء الاصطناعي أسئلة مقلقة: هل سيسيطر على البشر؟ هل سينقذ البشرية أم سيدمِّرها؟ ماذا سيحدث إذا فقدنا السيطرة على الخوارزميات المستقلة؟ هناك ثلاثة احتمالات:

1. برمجته للتدمير

فالأسلحة المستقلة الذكية المبرمجة للقتل ذاتياً قد تؤدِّي إلى حروب خارج السيطرة، وقد يستحيل علينا “إيقافها”.

2. برمجته للقيام بشيء مفيد، ولكن بآثار جانبية مدمِّرة

فمثلاً تُبرمج مركبة مستقلة بهدف الوصول إلى مكان “بسرعة” و”بكل ما يتطلب الأمر”، فتنجح في إكمال مهمتها، ولكن ما الدمار المصاحب؟ لعل محاولاتنا إيقافها تبدو لها تهديداً يعوق إنجاز مهمتها. وسيكون الذكاء الاصطناعي الخارق فعالاً في تحقيق الأهداف، لكن هل تحقيق هذه الأهداف تحت سيطرتنا؟ وإذا خرج عن السيطرة سيصبح مصيرنا في يد آلة. ولامتزاج الذكاء الاصطناعي الوثيق بالأمن، يُسبب استخدامه الضار تهديدات متنوِّعة: أمنية سيبرية وفيزيائية، والديمقراطية والخصوصية.

3. تجارب غير أخلاقية

مثل تلاعب الشبكات الاجتماعية في “آخر الأخبار” News Feeds دون وعي المستخدمين.

إقصاء

تُشكّل تحيزات الذكاء الاصطناعي مخاطر أخلاقية، مثل تعميق الإقصاء على أساس الجنس والعرق مما يؤثر سلباً على أداء الروبوتات الطبية والمركبات المستقلة. وكان وراء ذلك تحسّن دقة “تعلّم آلة” من تصنيف صحيح من الصور (%70) إلى تصنيف عالٍ (%98)، أفضل من المعيار البشري (%95).

ويفترض أن التقنية موضوعية أي “خالية من القِيَم” التي تفرضها الإنسانية، بيد أن قِيَم التقنية تحتوي قِيَم المصمم الإنسان كواقع. فقد يتحقق المصمم من صحة مخرجات خوارزمية متحيزة ضد عرق معيَّن، لكنه لم يختبر التحيز ضد عرق آخر، أو يهمله، أو يغفل “التقاطعية”.

وهناك حالياً أزمة تفاوت في مصممي الذكاء الاصطناعي. فقد تبيَّن تقلّص مشاركة المؤلفين النسوة في المؤتمرات (%18 فقط)، بينما أكثر من %80 رجال. ونسب النسوة الباحثات متدنية أيضاً؛ فهن %15 فقط في “فيسبوك” و%10 في “جوجل”.

أثارت حمّى الذكاء الاصطناعي أسئلة مقلقة: هل سيسيطر على البشر؟ هل سينقذ البشرية أم سيدمرها؟ ماذا سيحدث إذا فقدنا السيطرة على الخوارزميات المستقلة؟

وبالنسبة للعمال السود، فإن التفاوت أسوأ، فمثلاً، %2.5 من العاملين في “جوجل” من السود و%4 في كل من “فيسبوك” و”ميكروسوفت”. ومن أمثلة التحيُّز في تصنيف خوارزميات التعرف على الوجوه كان التصنيف أفضل للذكور الفاتحة بشرتهم، بينما كان أسوأ للإناث الداكنة بشرتهن. والتحيز في الرعاية الصحية الذكية، كان عرقياً، فالسود أكثر مرضاً؟ مما يعني زيادة السود الذين يتقاضون مساعدات من %17.7 إلى %46.5، وبالتالي رعاية أقل للسود.

وفي كثير من الأحيان، تُستبعد أقاليم الجنوب من التقنيات المتقدِّمة حيث أوضحت سلسلة التوريد العالمية للذكاء الاصطناعي (البيانات، والقوة الحسابية، والموارد الطبيعية، والعمالة) استمرار التحيُّز للشمال الاستعماري وتبعية الجنوب.

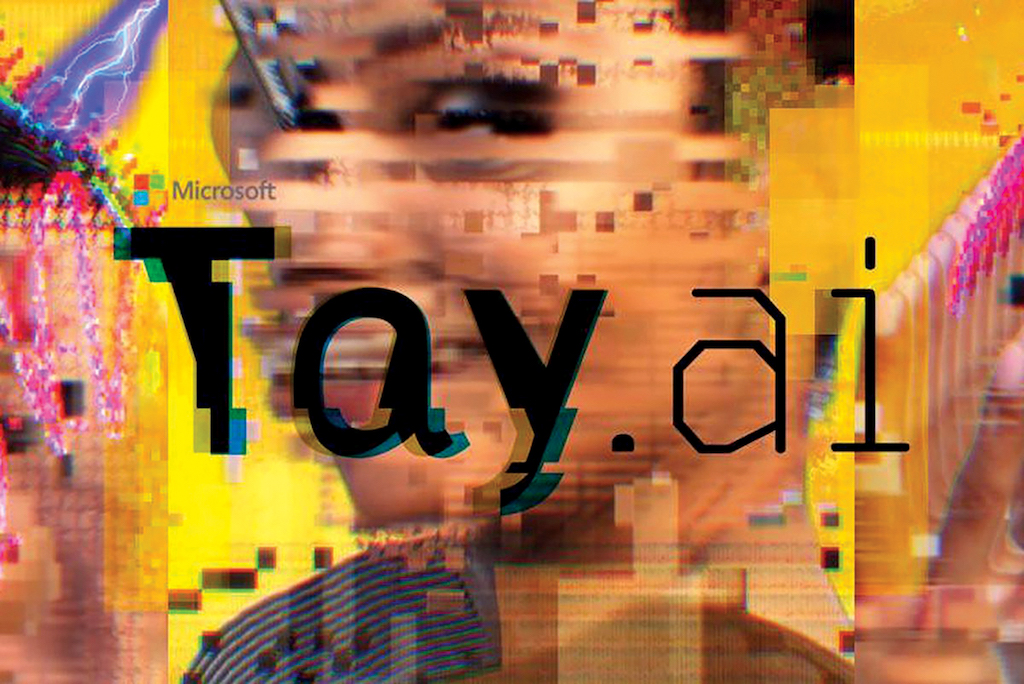

المطورون

تضع خوارزميات “تعلّم آلة” مخاطر ومسؤوليات إضافية ليس على مطوري الخوارزميات وعلى المدربين أيضاً. وتشمل تهديدات المطورين الرئيسة مجموعة تقنيات تهدف إلى تضليل النماذج من خلال مدخلات تشويش عدوانية. فمثلاً لم ينظر المطورون إلى المخاطر الأخلاقية التي قد يتعرَّض لها المجتمع عندما يتعلّم روبوت الدردشة “تاي” الكراهية ويطلق العنان لنشر تغاريدها، مما دعا “مايكروسوفت” إلى إغلاقه في غضون 24 ساعة.

السؤال؛ هل نجعل بين المسؤولية وبين كلا المطورين والمدربين نسباً؟ كان “تاي” محدداً وصادقاً في مهمته بتغيير سلوكه حسبما يتعلمه مثلما صُمّم وتدرّب، فلا غبار عليه. حتى التجارب الطبية على البشر كان لها ماضٍ سيئ السمعة. فقد كانت التجربة اللاأخلاقية “توسكيجي” Tuskegee، بمثابة دلالة على ضرورة إلغاء البحوث العلمية عندما يصاحبها مخاطر أخلاقية و”حوسلة”؛ وكذلك زرع خلايا بشرية داخل أجنة قرود؛ وهذا مأزق العلمانية الشاملة.

“الأنْسنة”

مع السيليكون والإلكترونيات الدقيقة والحوسبة الذكية، قام الإنسان باختراع آلات يمكن أن نتحدث معها، وتتعلم منا، وتمشي معنا. وعكس القصص الإغريقية الخيالية، نحن موعودون بروبوتات تشبه الإنسان بشكل متزايد، ولكنها تُثير أسئلة جدلية مهمة:

1. السؤال 1: هل يمكن “أنسنة” الذكاء الاصطناعي المستقبلي بسهولة؟

2. السؤال 2: هل سيتقبل المجتمع ذلك؟

3. السؤال 0 المعياري (الأكثر أهمية): هل يُعدُّ بعض عناصر الذكاء الاصطناعي، سواء الآن أو في المستقبل، إنساناً؟

فإذا كانت هناك آلات “مؤنسنة”، فسينجحون في اختبار “تورينج” ، وتصبح إجابة السؤال 1 هي “نعم”؛ والعكس، فالإجابة تُصبح “على الأقل ليس بعد”. وبالمثل، إذا لاحظنا أن معظم البشر يعاملون مصنوعات الذكاء الاصطناعي كما لو كانت إنساً، فإن الإجابة عن السؤال 2 هي “نعم”، والعكس فالإجابة تصبح “على الأقل ليس بعد”.

وفي ثنايا السؤال 0، فإن “أنسنة” الأدوات الذكية خيار مجتمعي وليس تصنيفاً علمياً. ويمكن التعبير عنه كعرف أو كلائحة. لذلك، لا يمكننا ابتكار اختبار جسدي أو سلوكي للسماح لأدوات الذكاء بدخول “نادي الإنسان”. لقد خلق الله الإنسان من طين ثُمَّ سَوَّاهُ وَنَفَخَ فِيهِ مِن رُّوحِهِ، في حين يعتمد تصميم الذكاء الاصطناعي على برمجيات رقمية تحاكي ذكاء الدماغ البشري في رقائق السيليكون وبدون روح.

ولا يزال الذكاء الاصطناعي يقدِّم استجابات ثابتة بغض النظر عن السياق وضالاً عن عواطف الإنس واحتياجاتهم لأنه خاوي الضمير. ويستحيل حسبان مصنوعات الذكاء الاصطناعي أناسيّ لا الآن ولا في المستقبل. “فالروبوتات عبيد للإنس”، وليسوا مسؤولين أخلاقياً ولا قانونياً. ثم يتداعى سؤال آخر، لماذا نبني روبوتات تتصرف تبدو كأنها إنسان؟ هل لأننا نستطيع؟ أم لأن هذه الآلات توفر لنا وظائف من الصعب الحصول عليه بطرق أخرى؟ لماذا نصمم الروبوتات خارج تفاعلاتنا في حين نحن مدفوعون بالتجارب والبيانات والمدخلات الإنسانية؟

تزييف

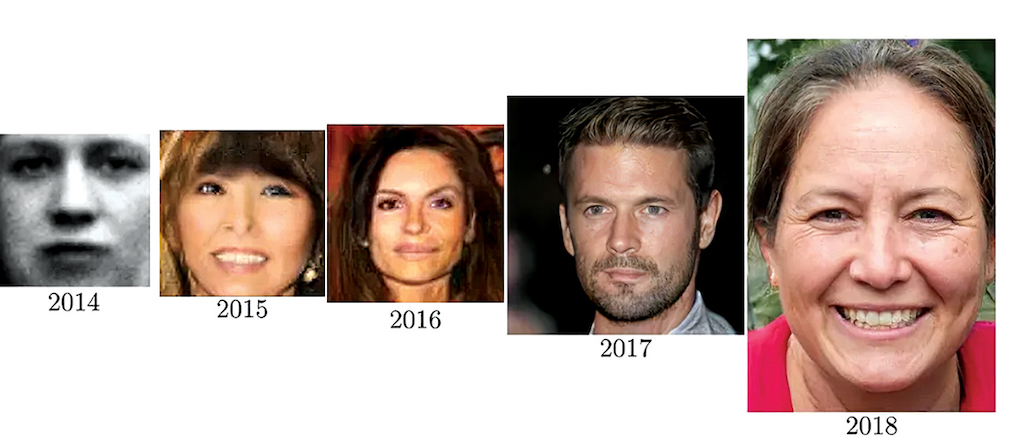

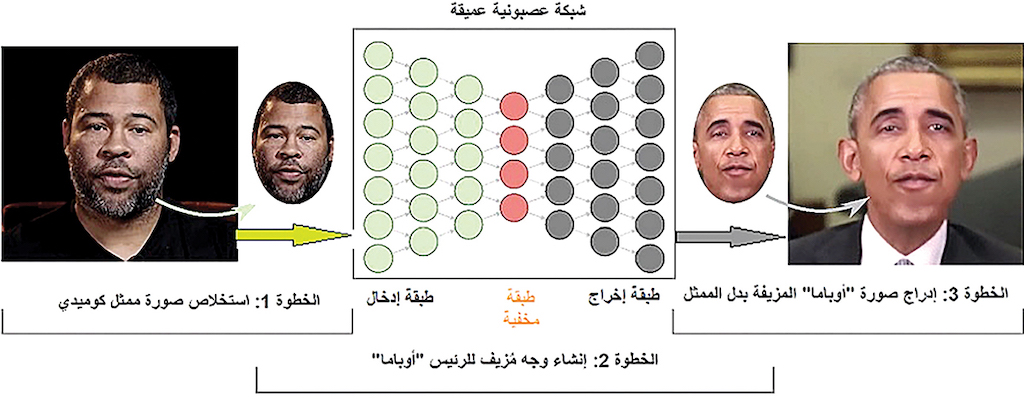

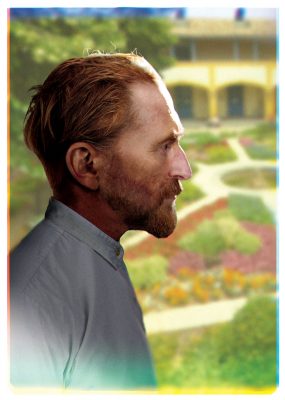

أدى التقدُّم في “الشبكات العصبونية العميقة”؛ مثل برمجيات “التزوير العميق” Deepfake، و”شبكات التنافسية التوليدية”، إلى اندلاع حروب جديدة تختلق معلومات باستخدام الوسائط المُزوّرة كأسلحة. وفي حين تُضيف تقنيات الوسائط المصطنعة عدّة فرص إيجابية، لكنها في الوقت نفسه تتسبَّب في تهديدات أخلاقية. ويُعدُّ الإقناع، والمصداقية في الوسائط المزورة تحدياً أخلاقياً لعالم يرتاب فيما يراه أو يسمعه؛ هل هو حقيقي أم مزيف؟ مثلاً، استطاع التزوير العميق اختلاق صورة رقمية مزيفة للرسام “فان جوخ” في شبابه في حين أنها غائبة.

المكوِّن الرئيس في تقنية “التزييف العميق” هو تعلّم آلة، حيث يقوم المُزيّف بتدريب “الشبكات العصبونية العميقة” على عدة ساعات من لقطات مرئية حقيقية للشخص لمنحه “فهماً” واقعياً لاستبدال محتوى مرئي وصوتي لشخص بشخص آخر، أو لإدراج وجوه المشهورين في المرئيات التجارية، أو تزوير صوت ومرئيات الرؤساء.

خطوات ثلاث لإنشاء “تزوير عميق”.

واصطناع وسائط تخدع تبدو حقيقية لها تداعيات وتهديدات ضارة لأنها كذب وخداع وإضلال. وازدادت صعوبة التمييز بين مرئيات “التزوير العميق” والأصيلة. كذلك تدنت العوائق التي تحول دون إنشاء “المزيفات العميقة” مع إتاحة التطبيقات (مثل “فِيكْأَب” FakeApp، و”زَاوْ” ZAO، و”دي فيكر” و”فِيسيسْوَاب-جَانْ” faceswap-GAN & DFaker) مجاناً على موقع أكبر مُضيف لكود المصدر “جِيتْهَبْ” GitHub، فاجتذب اهتمام الهواة حديثاً.

لم ينظر المطورون إلى المخاطر الأخلاقية التي قد يتعرَّض لها المجتمع عندما يتعلّم روبوت الدردشة “تاي” الكراهية ويطلق العنان لنشر تغاريدها، مما دعا “مايكروسوفت” إلى إغلاقه في غضون 24 ساعة.

ولبساطته ولإقناعه المتعاظم ولانتشار “الرقمنة”، سينمو استخدام المزيفات العميقة ولكن لأغراض ضارة : مثل الابتزاز، والترهيب، والتخريب، والتشهير، والانتقام الإباحي (مثل غمر الإنترنت بصور فاضحة لوجه طالبة على جسد ممثلة إباحية)، وسرقة الهويات والاحتيال المالي، والتنمر، والخداع السياسي (مثل تحذير “بوتين” المرئي المزيف الأمريكيين من هلاكهم الذاتي)، وحروب المعلومات المُضِلَّة. وهنا يكمن خطر عظيم. تخيَّل مقطعاً مرئياً مزيّفاً يُصوّر مسؤولاً في محادثة خاصة مع زميل يكشف فيه عن خطة سلسلة اغتيالات سياسية، أو مقطعاً صوتياً مصطنعاً لمسؤولين يخططون لشن تجسس إلكتروني على آخرين، أو مقطعاً مرئياً يُظهر جندياً يدهس طفلاً. ففي عالم مُهيأ للعنف، سيكون لمثل هذه التسجيلات المُزوّرة تحريضاً على الفتن وعواقب لا يُحمد عقباها. ومن المثير للقلق أن الجماعات الإرهابية، حتى والدول، ستتمكن من تصوير خصومها وهم يطلقون كلمات تحريضية أو ينخرطون في أعمال استفزازية لتعظيم التأثير على الجماهير. وسيصعب كشف الوسائط المزيفة خصوصاً حينما يكون الجمهور المستهدف لا يثق بالفعل في الشخص الأصلي.

ولذلك جزعت أمريكا من تدخل روسيا في انتخابات الرئاسة الأمريكية 2020م باستخدام تقنية “التزوير العميق” لهدم ديمقراطيتها. وللأخبار الكاذبة تأثير اقتصادي سلبي كبير أيضاً، مثل المقالة المُزوّرة التي أخطأت الاقتباس عن قصد من تصريحات رئيس شركة، مما أدى إلى دعوات للمقاطعة وانخفاض %3.75 في سعر السهم، أو مثل التسويق لاتجاهات أخبار. وحظرت “فيسبوك” حسابات مستخدمين لتحريضهم على العنف والإضلال والتدخل الأجنبي والحكومي (منهم الرئيس “ترمب”).

أما “شبكات التنافسية التوليدية”، عكس “التزوير العميق”، فتستطيع إنشاء محتوى طبيعي جديد تماماً نابض بالحياة نتيجة تخاصم خوارزميتين. في 2019م، عُثر على الإنترنت على 15,000 مقطع مرئي مزيف، أي حوالي الضعف على مدار تسعة أشهر. وكانت المواد الإباحية فيه مذهلة (%96)، ونسبة وجوه المشاهير الإباحية المزيفة عالية (%99).

استنتاج

• تصميم ذكاء اصطناعي محوره الإنسان وليس “حوسلة”

• لقيام الذكاء الاصطناعي بتحويل العالم بشكل عميق، نحتاج تصميماً أكثر تنوعاً ومساواة

• التحوُّل من “ماذا يمكن نصممه لك؟” إلى “ما الذي يمكننا تصميمه معك؟”

• تبني مصطلح “الذكاء الإنساني الطابع” كبديل للاصطناعي، لإدراج مبادئ الخُلُقِ العَظِيمِ الكريم الإنسانية.

اترك تعليقاً